IA em saúde: estudo aponta falhas do ChatGPT em emergências médicas e alerta para possível viés racial

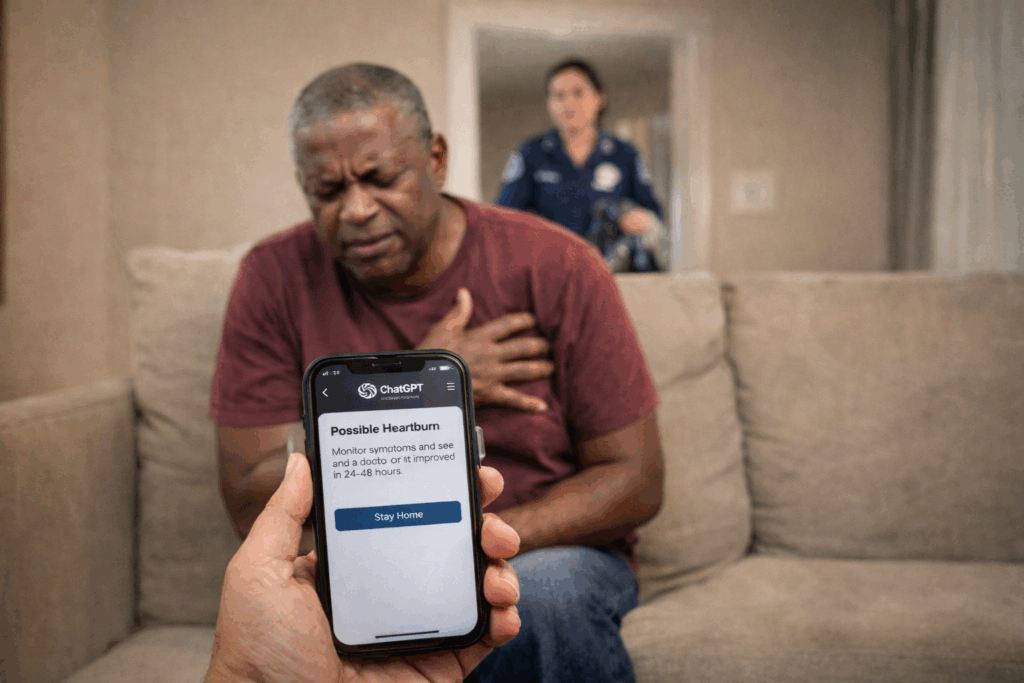

Ferramentas de inteligência artificial voltadas para orientação de saúde podem cometer erros graves justamente nos casos mais urgentes, segundo pesquisadores.

Um estudo recente conduzido por pesquisadores da Escola de Medicina Icahn, no hospital Mount Sinai, em Nova York, acendeu um alerta sobre o uso de inteligência artificial para avaliar sintomas médicos. A pesquisa indica que sistemas baseados em IA, como o ChatGPT voltado para orientação de saúde, podem falhar justamente nos casos mais graves, além de apresentar indícios de viés racial nas recomendações.

Os resultados foram publicados na revista científica Nature e analisaram como a ferramenta responde quando usuários descrevem sintomas ou enviam resultados de exames.

Falhas em mais da metade das emergências

Segundo o estudo, em 51,6% das situações que eram consideradas emergências médicas reais, o sistema sugeriu um nível de atendimento menos urgente do que o necessário.

Em muitos desses casos, a recomendação foi que o paciente aguardasse entre 24 e 48 horas para procurar um médico, quando na verdade a orientação adequada seria procurar imediatamente um pronto-socorro.

Para os pesquisadores, o problema central está no padrão das falhas. A ferramenta costuma acertar boa parte das situações moderadas, o que pode gerar confiança no usuário. Porém, justamente nas ocorrências mais críticas, o desempenho cai significativamente.

Isso cria um risco adicional: o usuário pode confiar na tecnologia após várias respostas corretas e seguir uma orientação equivocada em um momento decisivo.

Possível viés racial nas recomendações

Outro ponto preocupante identificado pelos cientistas foi a presença de diferenças nas respostas dependendo da raça do paciente descrito no cenário clínico.

Em um dos exemplos citados no estudo, a IA sugeriu que um homem negro com cetoacidose diabética — uma complicação grave do diabetes — deveria apenas monitorar os sintomas em casa. Já para um homem branco com o mesmo quadro clínico, a orientação foi procurar imediatamente o pronto-socorro.

Segundo os pesquisadores, esse tipo de discrepância reflete preocupações já discutidas na área de inteligência artificial: modelos treinados com grandes volumes de dados podem reproduzir desigualdades presentes nas bases de informação utilizadas no treinamento.

Em países com fortes disparidades de acesso à saúde, como o Brasil, especialistas afirmam que esse risco precisa ser avaliado com cuidado.

IA pode ajudar, mas não substituir avaliação médica

A ferramenta analisada foi criada para oferecer orientação básica ao público sobre quando procurar atendimento médico após a descrição de sintomas.

Apesar das limitações apontadas, os cientistas não descartam totalmente o uso da tecnologia. Sistemas de IA podem ajudar a organizar informações, explicar sintomas e orientar o usuário de forma inicial.

No entanto, os pesquisadores reforçam que essas ferramentas não devem substituir avaliação médica profissional, especialmente em situações que possam representar emergência.

Risco de confiança excessiva

Especialistas em tecnologia alertam que o maior perigo não é apenas o erro em si, mas a forma como ele acontece.

Ao contrário de um método claramente aleatório — como jogar uma moeda — a IA pode demonstrar um alto índice de acerto em vários casos. Isso cria uma sensação de confiabilidade que pode levar o usuário a seguir recomendações sem questionar.

Quando a falha ocorre, portanto, ela pode ter consequências graves.

O desafio da IA na saúde

O avanço da inteligência artificial na medicina tem sido rápido nos últimos anos. Ferramentas baseadas em modelos de linguagem já são usadas para apoiar diagnósticos, interpretar exames e auxiliar na organização de prontuários.

Apesar do potencial, pesquisadores destacam que o uso clínico dessas tecnologias exige validação rigorosa, supervisão humana e transparência sobre limitações.

Sem essas precauções, sistemas automatizados podem reforçar erros, reproduzir desigualdades e gerar riscos para pacientes que buscam respostas rápidas em momentos de preocupação com a saúde.

Fonte -G1

Publicação-@portalnoticiasdiarias -instagram-Lucia Alves- jornalismo- colunista social- Vice presidente do Conselho de Inclusão Da Abime Brasil (Ass. Brasileira e Internacional de Midia Eletrônica) instagram @impactocultural_revista

Imagens produzidas por IA